Opinion

”Så måste etik byggas in från början i ai-applikationerna”

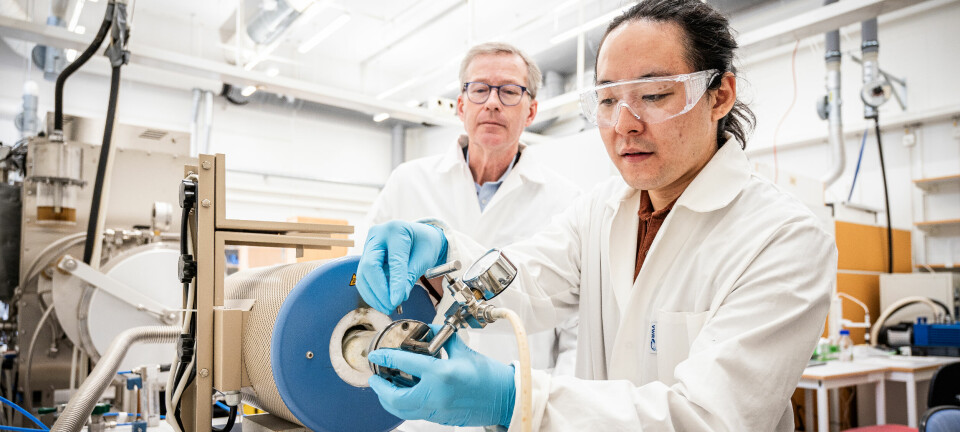

Josefin Rosén, ai-expert, Principal Advisor Analytics, SAS Institute Foto: SAS Institute

DEBATT. Etik är inte bara en check-box utan något som behöver genomsyra arbetet genom hela ai-applikationens livscykel, skriver Josefin Rosén på SAS Institute.

Det har gått några veckor sedan EU-kommissionen presenterade sitt lagförslag som ska ”göra Europa till ett globalt centrum för tillförlitlig artificiell intelligens”. Bemötandet är blandat där förvånansvärt många tycker att det är för strikta regler som föreslås. Man är rädd att regleringen ska hämma innovation och strypa ai-tillväxten.

Från EU-kommissionens håll understryker man att syftet inte är att bromsa eller försvåra ai-tillväxten och att man bara avser att reglera där det verkligen behövs, det vill säga när EU-medborgarnas säkerhet och grundläggande rättigheter hotas. Med de föreslagna reglerna och åtgärderna vill man skapa förutsättningar för en ai-utveckling som stödjer en positiv och ansvarsfull samhällsutveckling där medborgarna känner sig tryggare med ai, som i sin tur främjar ai-tillväxten.